这两天有不少的小伙伴私信我要DeepSeek的安装教程,说网页版动不动就提示“服务器繁忙,请稍后再试”

本来我也测试好了准备成文,但是想写得更详细点,所以一直拖着没发上来。

如果有不清楚的地方,大家可以评论留言,我尽量给大家解决。

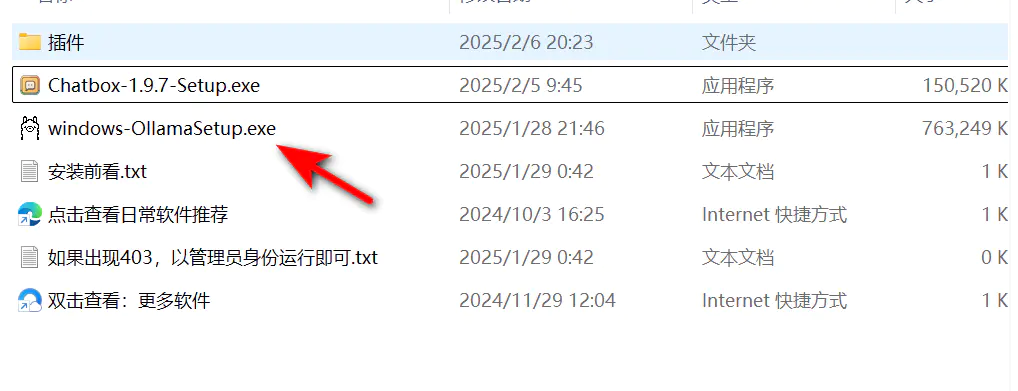

第一步:安装Ollama

Ollama是一个支持大模型本地调用的工具,DeepSeek这种大模型的调用就是基于Ollama,所以大家首先双击“windows-OllamaSetup.exe”

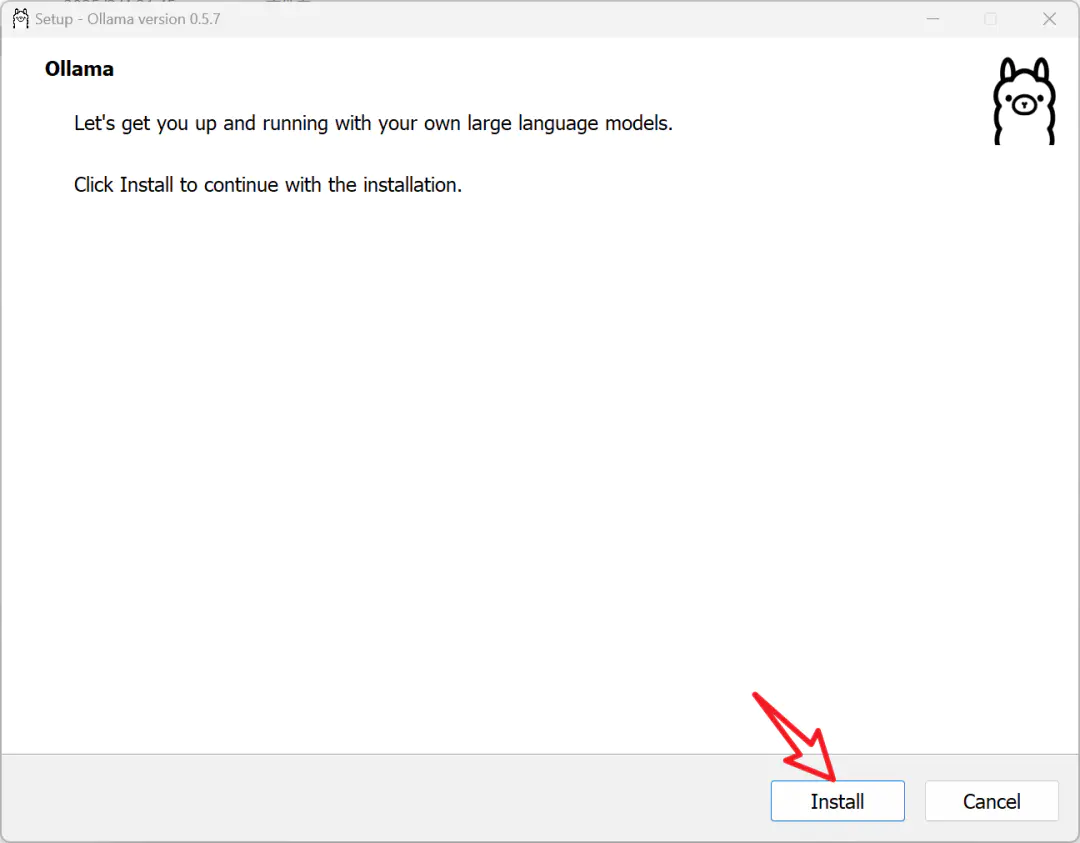

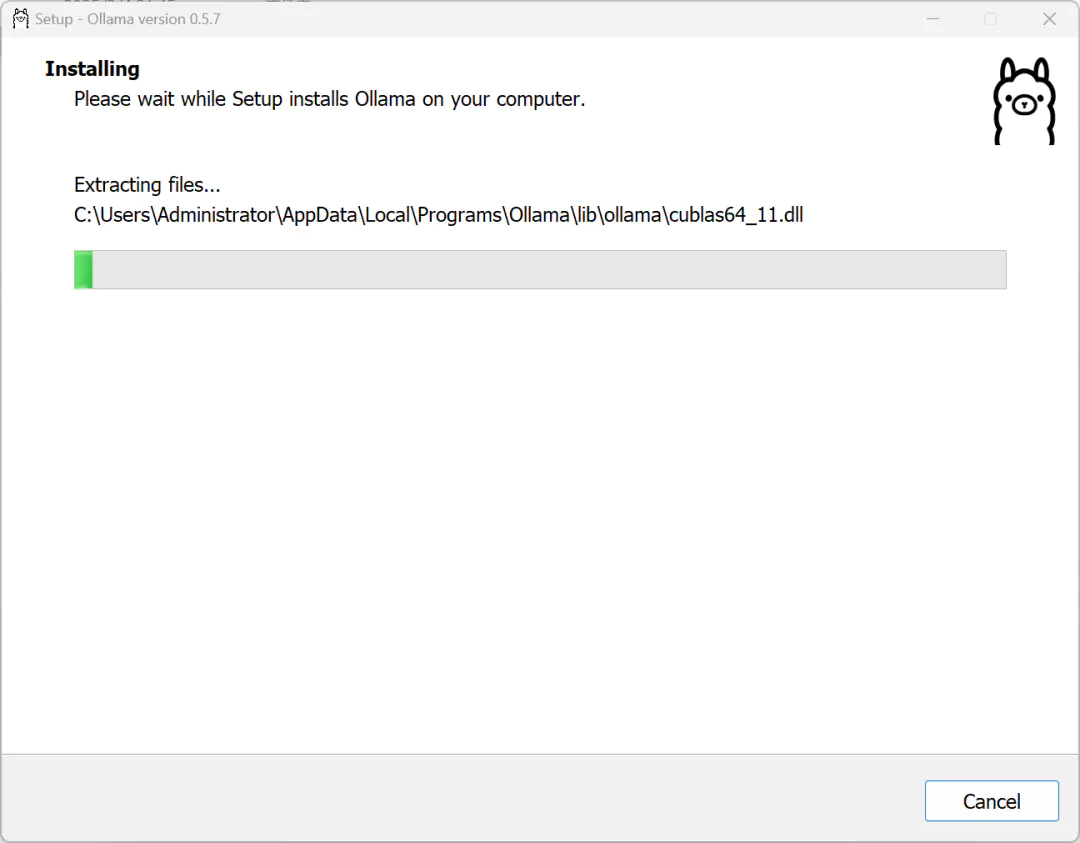

我以Windows为例,其安装过程是全英文,点击【Install】然后根据提示完成安装即可。

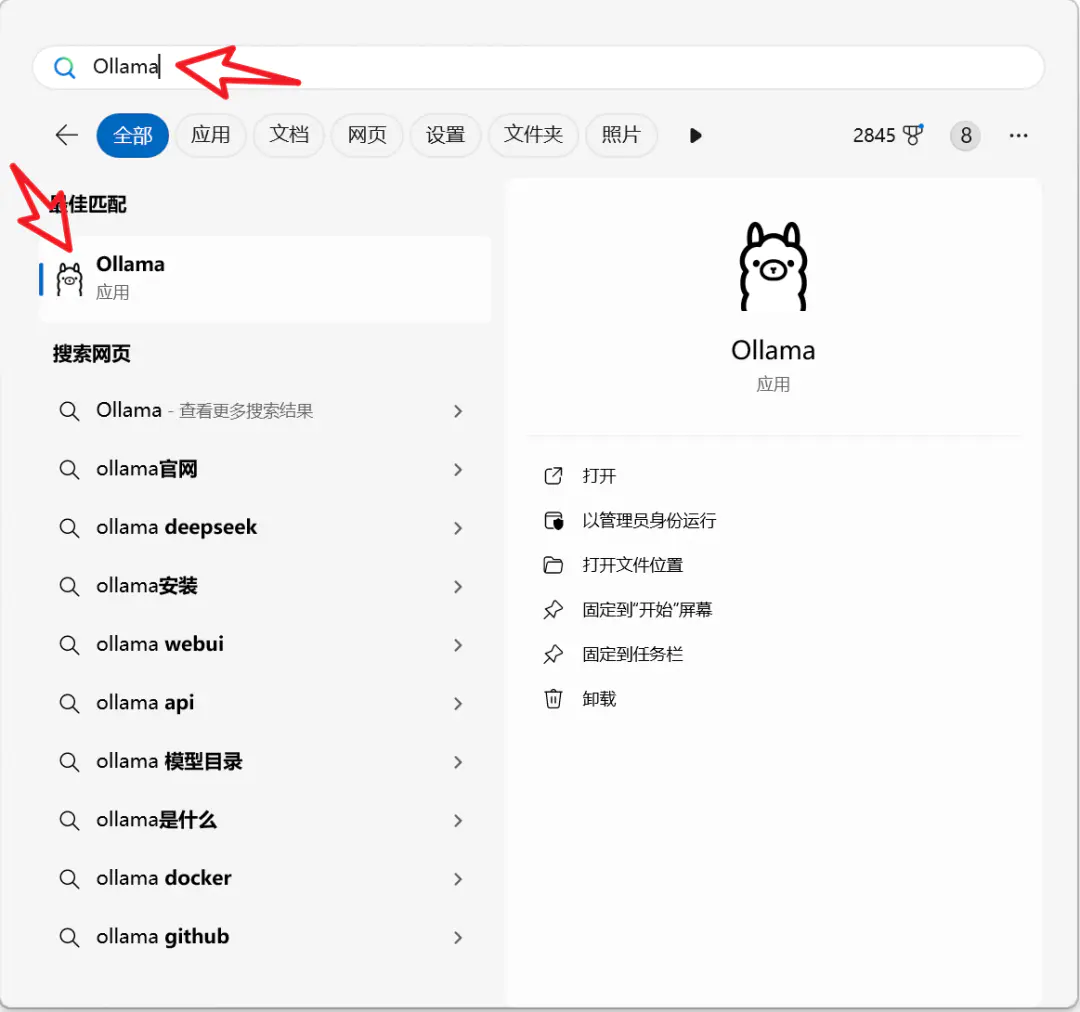

安装完成后,在电脑开始菜单,输入“Ollama”点击软件即可启动。

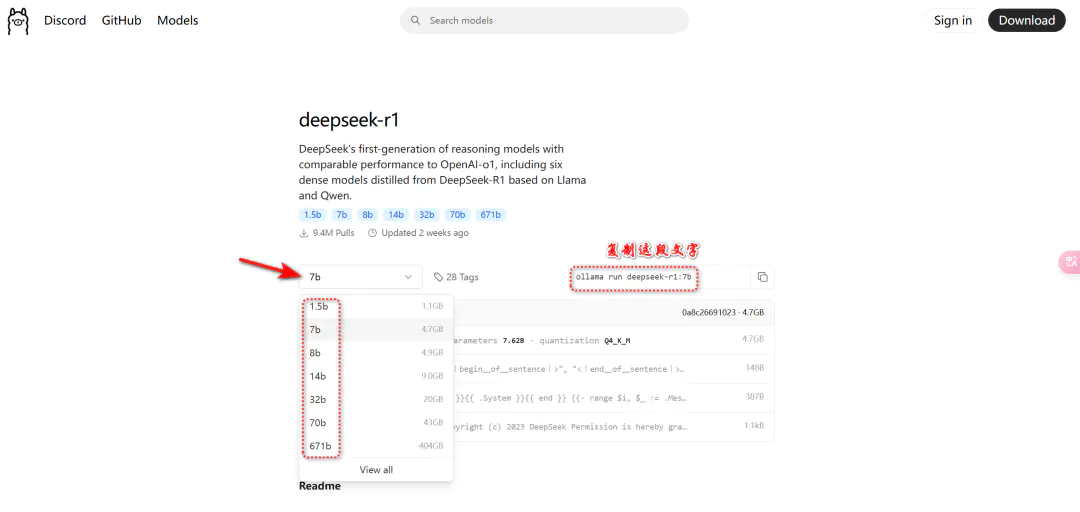

大家可以根据自己的电脑性能进行选择。・1.5B:入门级别,硬件配置“4GB内存+核显”即可运行;・7B:进阶级别,“8GB内存+4GB显存”可运行;

・32B:高性能设备推荐,“32GB内存+12GB显存”

这里推荐大家使用7B,绝大部分电脑都能运行。如果选择7B,则复制“ollama run deepseek-r1:7b”

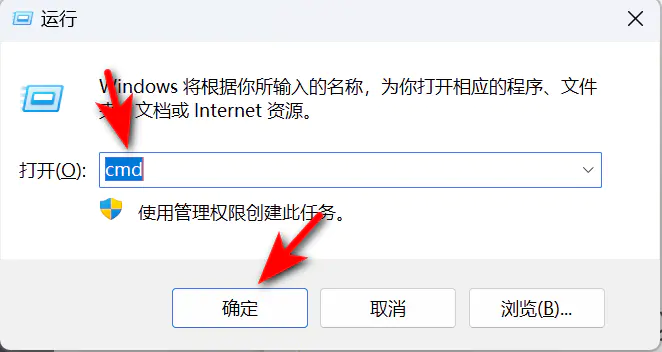

按下“Win键+R”,输入“cmd”打开命令行窗口。

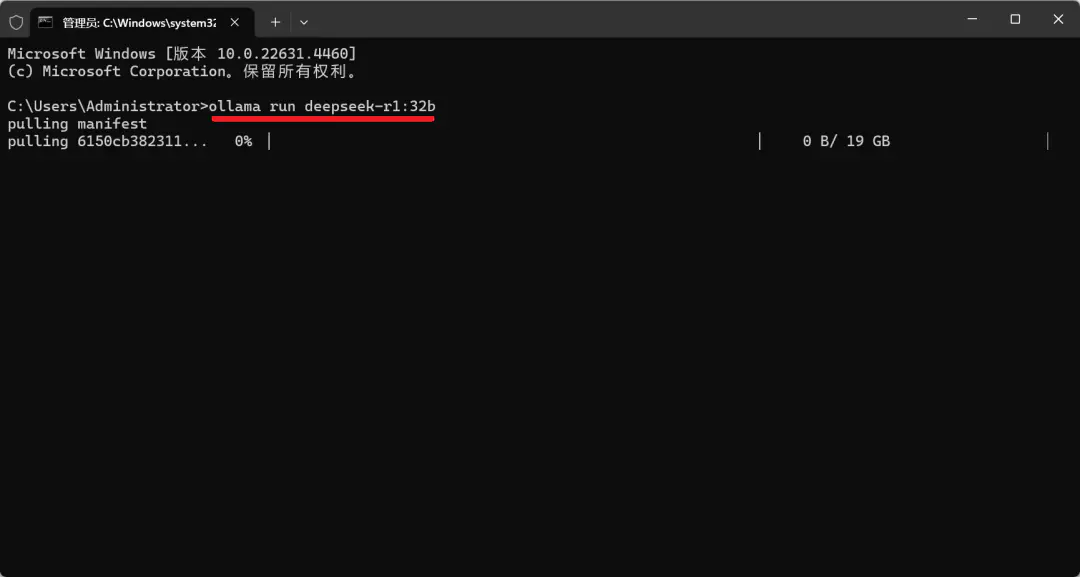

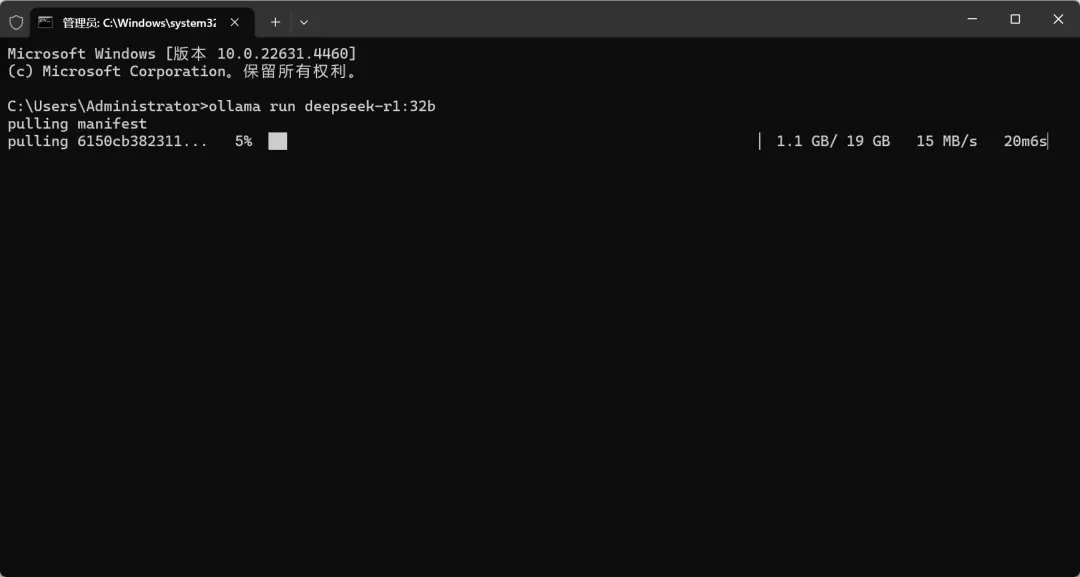

然后输入上面的那串文字“ollama run deepseek-r1:7b”,下图软妹电脑选择了32B,但事实是选择7B更好。

ollama run deepseek-r1:7b

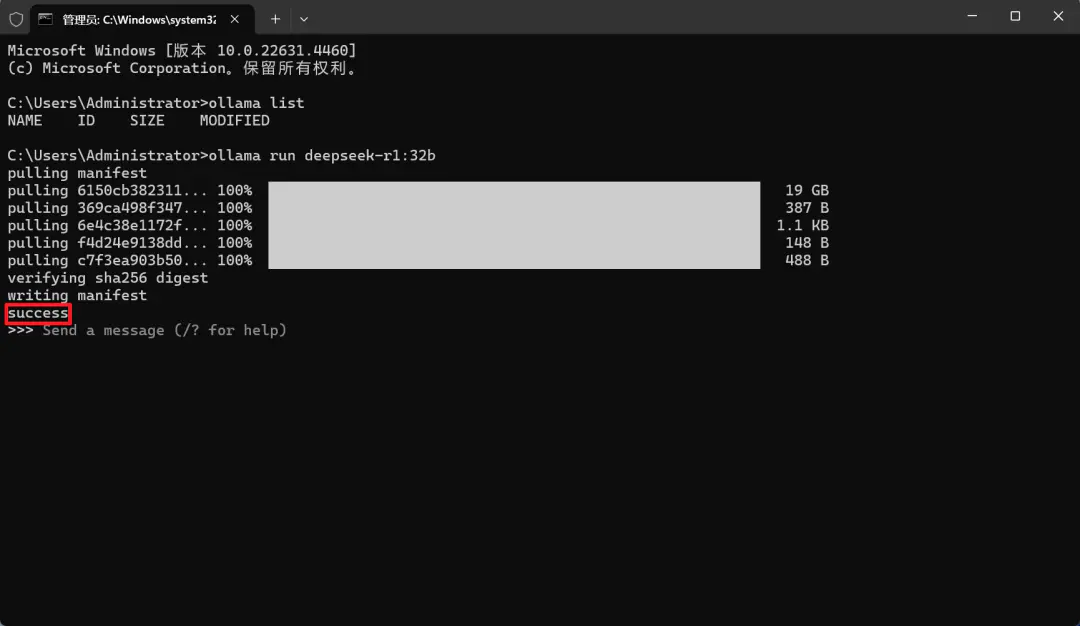

然后软件就开始下载大模型,我选择的32B需要下载19G的模型(再强调,大家不要选择32B,一般性能的电脑用7B即可),下载的速度有点慢,大家耐心等待即可。

当出现“success”时,就代表下载安装成功了,就可以运行了。

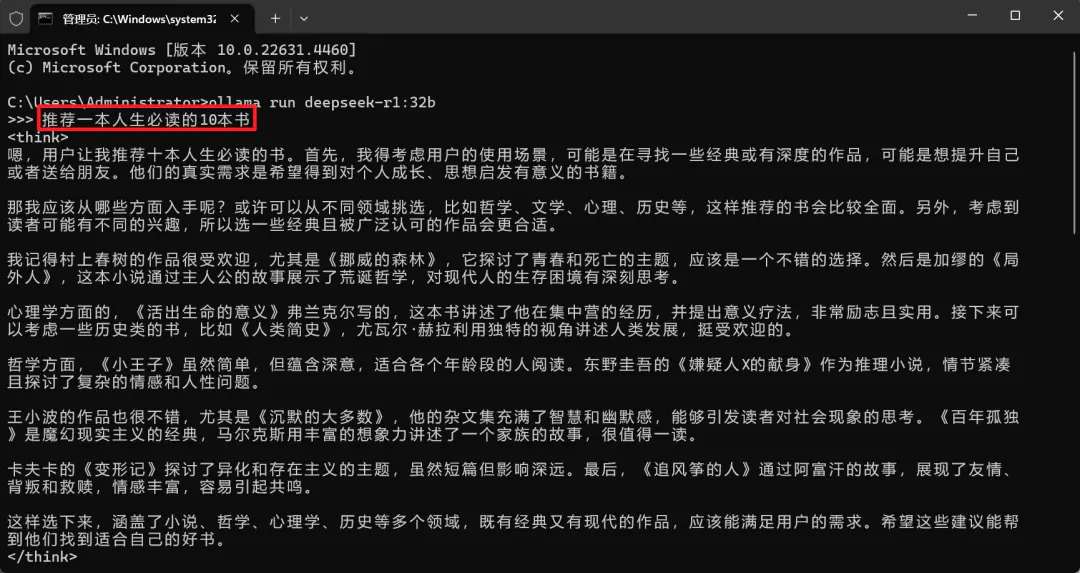

这时候你如果不要UI运行,则用命令窗口直接输入你想要的问题,DeepSeek就开始深度搜索,然后给出你想要的答案。

除了要调用cmd,输入你的模型的命令,操作有一丢丢麻烦。而且界面不好看,使用方面一点也不受影响!

如果不用界面,到这里大家部署完成,可以愉快的使用,下面的步骤都可以不用去安装了。

而如果想要界面,就得往下安装了。

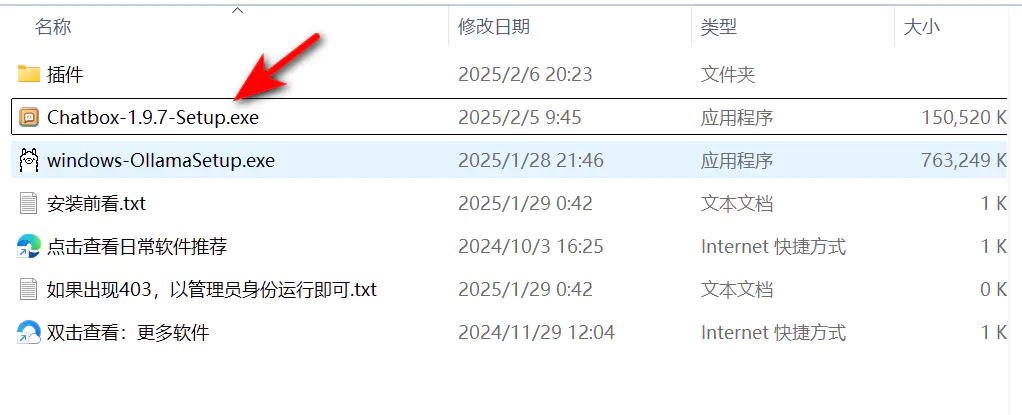

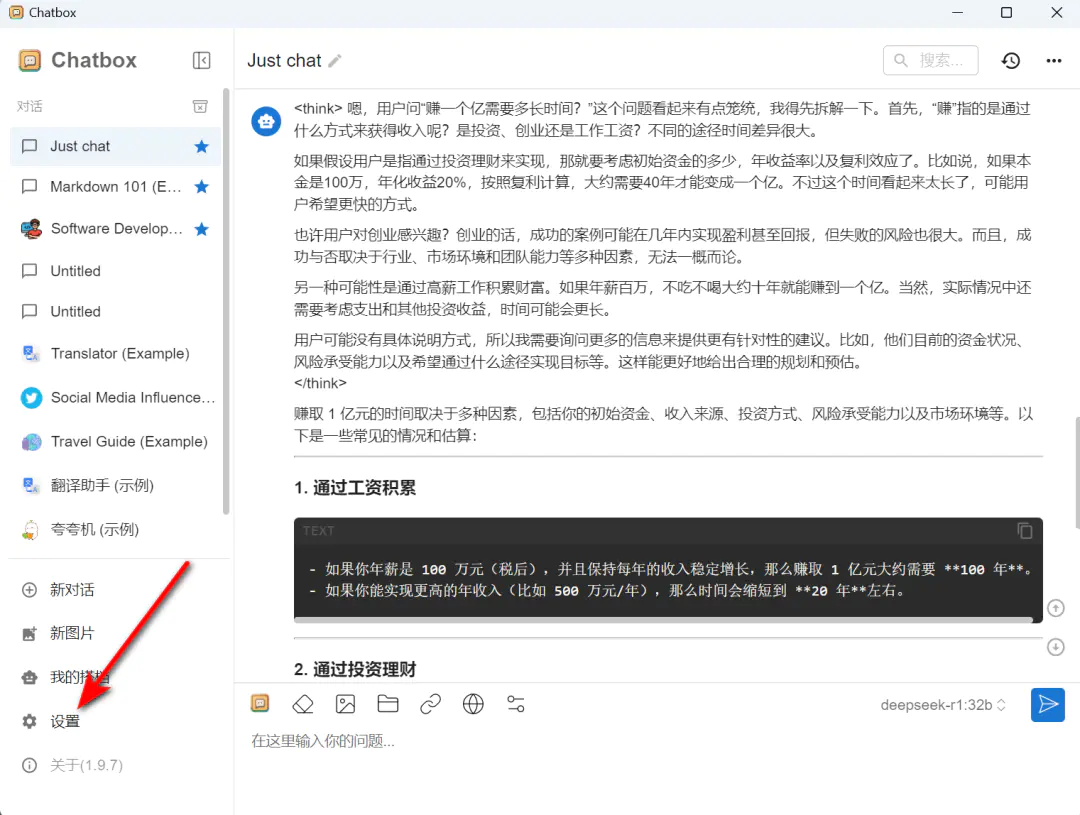

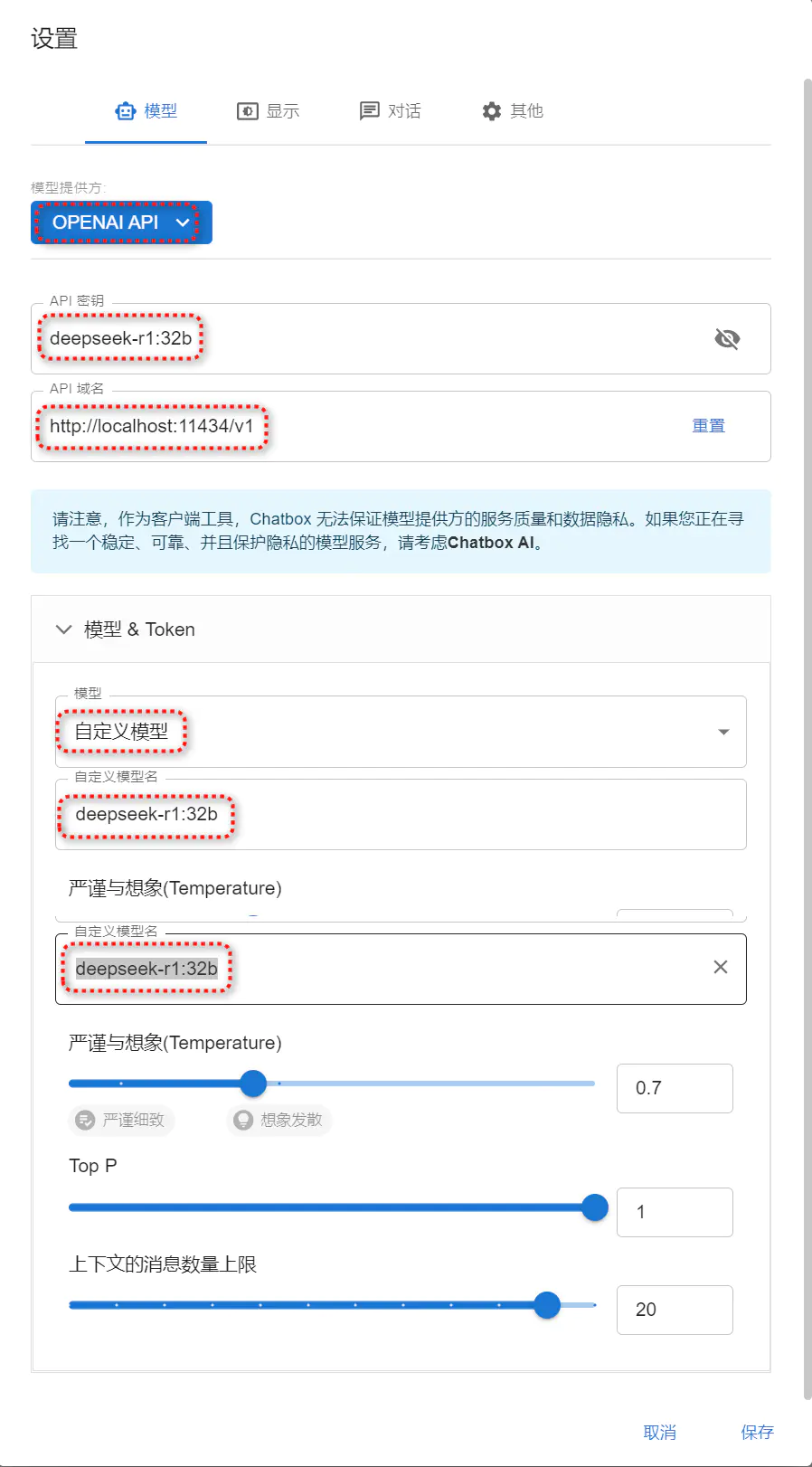

第三步:安装ChatBox

文末获取的软件中有Windows 64位的客户端,大家默认安装即可。

然后选择“OPENAI API”,依次填写API密钥、API域名、选择模型等等,注意我这里的是“32B”,填写的是“ollama run deepseek-r1:32b”,你们选择“7B”的要填写“ollama run deepseek-r1:7b”

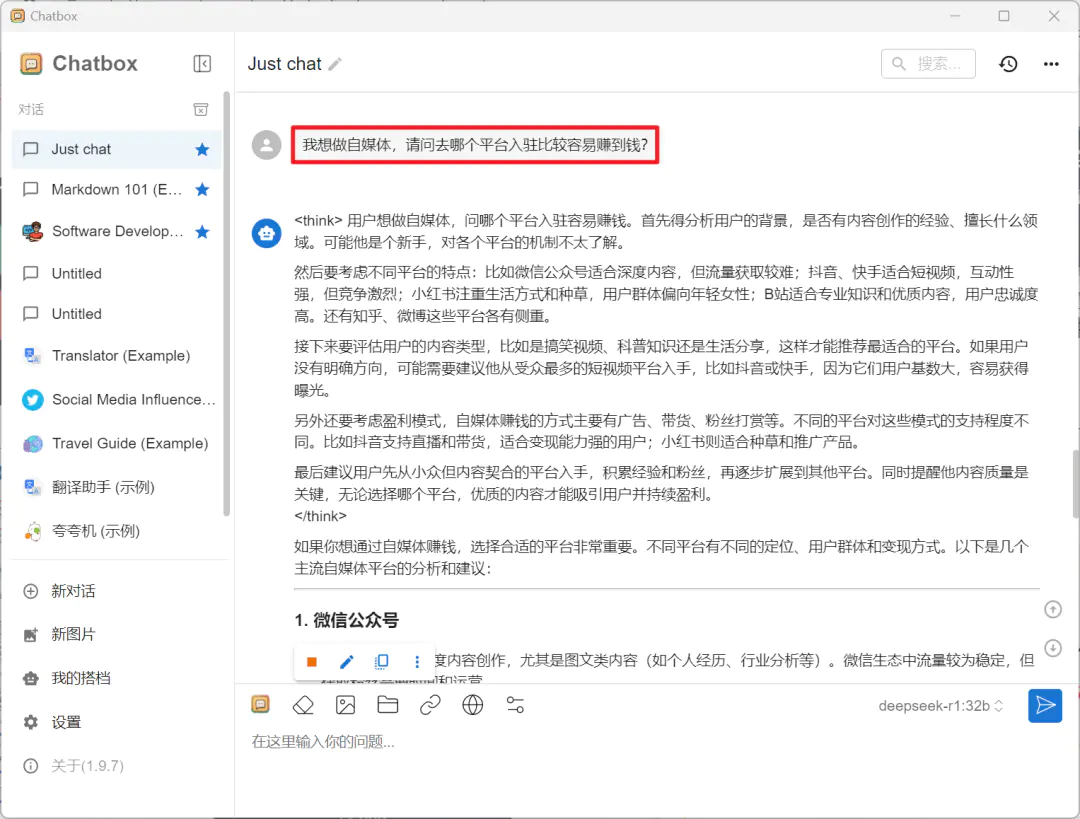

填写好后点【保存】,然后软件就可以调用DeepSeek进行对话了,输入你的问题,软件即给出你想要的答案。

说真的,有点吃配置,但是不会出现服务器繁忙的情况。

如果不要插件,那到第三步也就可以了,第四步不用安装了。

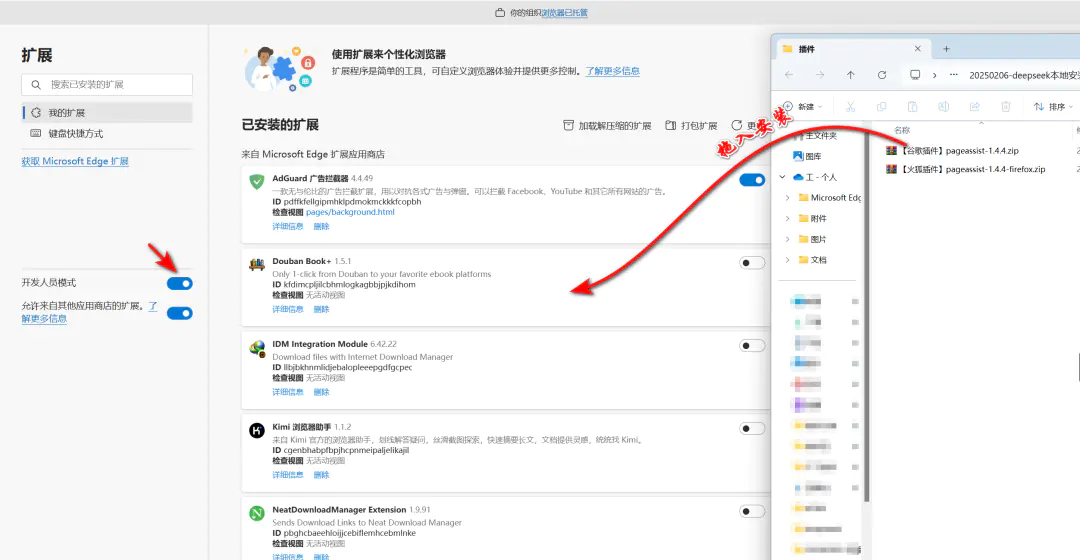

第四步:安装浏览器插件

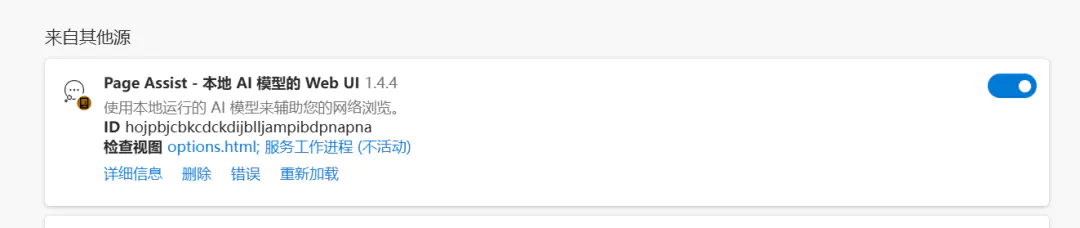

如果你不想安装第三步的ChatBox客户端,大家可以用浏览器插件,插件的安装是在扩展中心,打开【开发人员模式】,然后把压缩包直接拖入到扩展中心。

在插件中出现下面这个“Page Assist-本地AI模型的Web UI”时,代表插件安装成功。

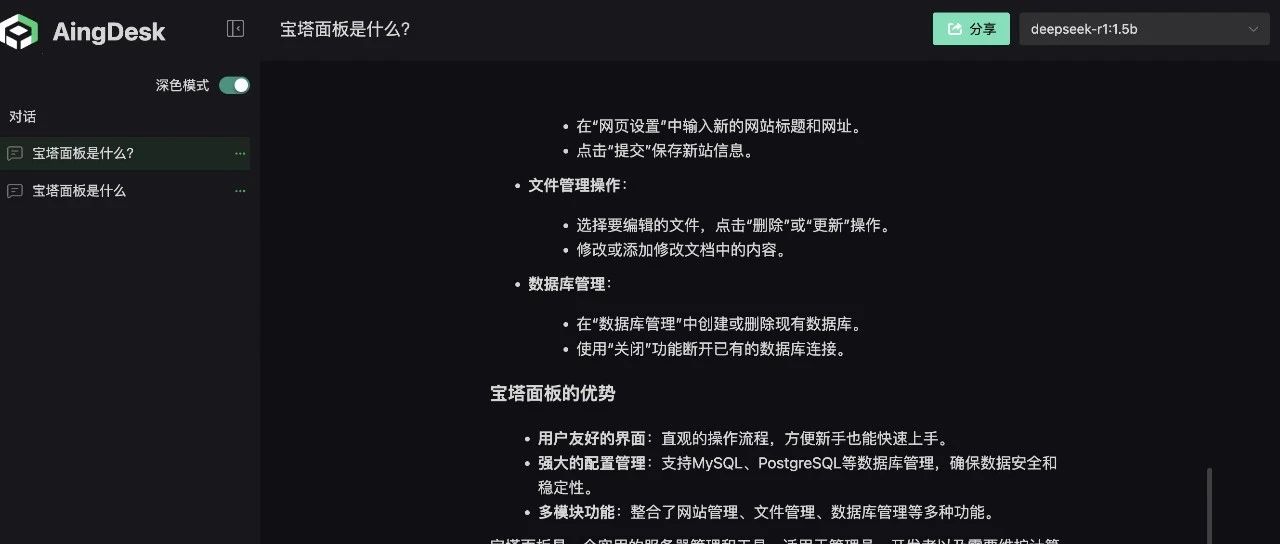

我们在浏览器中点击插件图标,然后选择模型,输入问题,DeepSeek就开始给出你想要的答案。

通过插件的形式也挺好用的,可以不用安装第三步的ChatBox,还能有界面可使用。

软件打包下载:

使用微信扫描小程序码获取资源

扫描上方小程序码 ,回复关键字口令【4538 】获取资源。

提示:本文最后更新于2025年2月12日 ,如有错误或者已经失效,请留言告知。

------本页内容已结束,喜欢请分享------ 感谢您的来访,获取更多精彩文章请收藏本站。

------关注微信公众号:映凡空间------

Invitation

created: 2022/05/10

Nice to meet you!

Use this card to join the YingFan's Space and participate in a pleasant discussion together .

Welcome to YingFan's Space,wish you a nice day .